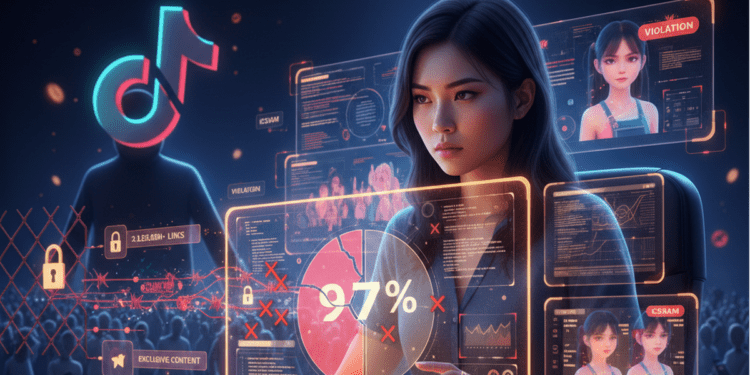

TikTok tự hào tuyên bố rằng họ đã chủ động loại bỏ 97% nội dung vi phạm bằng AI

TikTok, một trong những không gian kỹ thuật số có tầm ảnh hưởng lớn nhất đối với giới trẻ toàn cầu, đang đối mặt với cuộc khủng hoảng kiểm duyệt nghiêm trọng liên quan đến nội dung do trí tuệ nhân tạo (AI) tạo ra.

Nền tảng này luôn khẳng định ưu tiên an toàn của người dùng, đặc biệt là trẻ em, với tuyên bố rằng 97% nội dung vi phạm liên quan các chính sách về AI đã được loại bỏ, bao gồm cả những hình ảnh tình dục hóa người trẻ.

Tuy nhiên, một báo cáo chấn động từ tổ chức phi lợi nhuận Maldita.es đã phơi bày một lỗ hổng nghiêm trọng trong hệ thống kiểm duyệt, cho thấy hàng triệu lượt thích (likes) liên quan đến nội dung lạm dụng tình dục trẻ em do AI tạo ra (AI CSAM) vẫn tồn tại công khai trên nền tảng.

Thất bại kép và cầu nối nguy hiểm

Theo nghiên cứu của Maldita.es, hơn một chục tài khoản với gần 300.000 người theo dõi đã đăng tải các video AI mô tả trẻ vị thành niên trong trang phục khêu gợi hoặc tư thế gợi dục. Những video này đã thu hút hơn 2 triệu lượt thích, chưa kể số lượt xem.

Khi Maldita.es báo cáo 15 tài khoản và 60 video vi phạm rõ ràng, TikTok ban đầu từ chối hành động đối với hầu hết các trường hợp, khẳng định rằng chúng không vi phạm quy tắc.

Điều này cho thấy sự thất bại kép của TikTok. Đầu tiên là thất bại của thuật toán: Nếu 97% nội dung vi phạm AI được gỡ bỏ chủ động, tại sao hàng triệu lượt tương tác với video khiêu dâm trẻ em do AI tạo ra vẫn vượt qua được bộ lọc tự động và tồn tại trong thời gian dài?

Tiếp theo, khi được báo cáo thủ công từ người dùng, các kiểm duyệt viên đã quyết định sai lầm, cho phép video tiếp tục được lan truyền, thậm chí sau khi đã được kháng nghị.

Báo cáo của Maldita.es cũng chỉ ra rằng phần bình luận của những video này thường chứa các liên kết đến các kênh Telegram và trang web riêng tư, nơi quảng cáo và bán nội dung lạm dụng trẻ em.

Đây là một mô hình khai thác nguy hiểm: các tài khoản TikTok sử dụng nội dung AI gợi dục để thu hút lượng lớn người xem quan tâm đến hành vi ấu dâm, sau đó chuyển hướng họ sang các nền tảng ít bị kiểm soát hơn như Telegram để thực hiện giao dịch bất hợp pháp. Điều này biến TikTok trở thành một công cụ tuyển dụng và tiếp thị cho các mạng lưới bóc lột trẻ em.

Lỗ hổng kiểm duyệt AI bằng công nghệ

Công nghệ AI tạo sinh (Generative AI), đặc biệt là các mô hình tạo ảnh và video, đang trở nên tinh vi hơn, cho phép những kẻ xấu tạo ra nội dung vi phạm trông cực kỳ chân thực và khó phân biệt. Đây là một thách thức lớn đối với các công cụ kiểm duyệt dựa trên AI của TikTok.

Nếu các hệ thống AI của TikTok không thể nhận diện được sự tình dục hóa trẻ em trong bối cảnh AI (ví dụ: quần áo, tư thế, biểu cảm), thì tỉ lệ 97% chỉ là một con số vô nghĩa. Nó buộc TikTok phải đầu tư khẩn cấp vào các mô hình phát hiện tiên tiến hơn, có khả năng nắm bắt được sự tinh vi của các nội dung do AI tạo ra, đồng thời tăng cường sự giám sát và đào tạo nhân lực để đảm bảo tính chính xác khi xem xét các báo cáo từ cộng đồng.

Nếu không, TikTok sẽ tiếp tục đối mặt với áp lực pháp lý gia tăng, đặc biệt khi các quốc gia như Úc đang siết chặt luật an toàn trực tuyến cho trẻ vị thành niên.