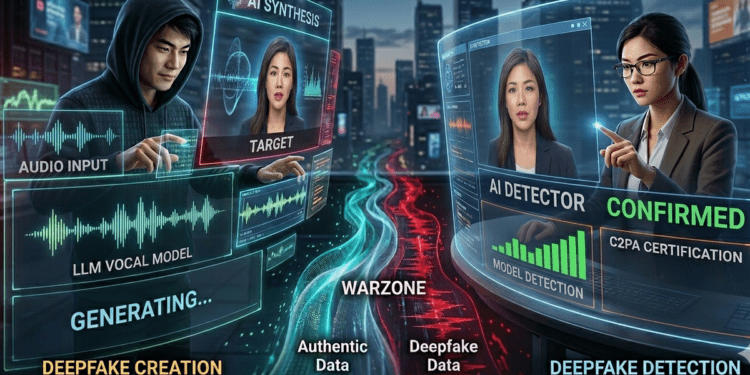

Cuộc chiến chống Deepfake khi AI trở thành cả “vũ khí” lẫn “khiên chắn”

Trong kỷ nguyên AI, cuộc đối đầu giữa tội phạm mạng và các công ty bảo mật không còn đơn thuần là cuộc đua công nghệ, mà trở thành nỗ lực giành lại niềm tin đang bị xói mòn bởi các nội dung giả mạo ngày càng tinh vi.

Khi ‘mắt thấy tai nghe’ không còn đáng tin

Chỉ vài năm trước, người dùng còn có thể nhận diện deepfake qua những dấu hiệu khá “thô” như khuôn mặt thiếu tự nhiên, khẩu hình không khớp hay ánh mắt bất thường. Tuy nhiên những cách nhận biết này nhanh chóng trở nên lỗi thời, khi công nghệ AI phát triển.

Hiện nay AI có thể tái tạo hình ảnh và giọng nói với độ chính xác rất cao, thậm chí mô phỏng được cả những rung động tinh vi trong giọng nói con người. Trong một thử nghiệm của phóng viên Gaby Del Valle, chỉ với 9 giây âm thanh thu thập từ mạng xã hội, hệ thống AI đã tạo ra một phiên bản giả có thể duy trì cuộc trò chuyện gần như thuyết phục.

Trong đời sống thường ngày, trực giác vẫn có thể giúp con người nhận ra điểm bất thường. Tuy nhiên trong môi trường công việc hoặc các giao dịch tài chính – nơi thông tin được xử lý nhanh và áp lực thời gian lớn, những dấu hiệu nghi ngờ này dễ bị bỏ qua, làm tăng nguy cơ bị lừa đảo.

Deepfake hiện không còn dừng ở những nội dung giải trí trên mạng, mà đang bị tội phạm mạng khai thác cho các kịch bản lừa đảo có tổ chức. Chúng có thể thu thập dữ liệu công khai trên mạng xã hội để xây dựng “kho giọng nói” của nhân viên trong doanh nghiệp, rồi dùng AI giả danh lãnh đạo hoặc đồng nghiệp nhằm thực hiện các cuộc gọi yêu cầu chuyển tiền.

Thiệt hại từ các vụ việc này không nhỏ. Mỗi vụ lừa đảo deepfake có thể khiến doanh nghiệp mất hàng trăm ngàn USD. Đáng lo ngại, các kịch bản thường đánh vào tâm lý khẩn cấp – như giả giọng người thân cầu cứu – khiến nạn nhân mất cảnh giác chỉ trong thời gian rất ngắn.

‘Lấy độc trị độc’ bằng AI

Để đối phó, nhiều startup bảo mật lựa chọn cách tiếp cận ngược: dùng chính AI để phát hiện deepfake.

Một trong những phương pháp phổ biến là mô hình “thầy – trò” trong máy học. Hệ thống được huấn luyện bằng lượng lớn dữ liệu thật và giả để học cách nhận diện những dấu vết kỹ thuật mà con người không thể thấy bằng mắt thường.

Cách làm này tạo ra một vòng lặp liên tục: khi deepfake ngày càng tinh vi, các hệ thống phát hiện cũng phải liên tục được nâng cấp để theo kịp. Cuộc chạy đua vì thế gần như không có điểm dừng.

Tuy nhiên thách thức nằm ở chỗ chi phí tạo ra nội dung giả ngày càng rẻ nhờ các mô hình AI phổ biến, trong khi việc phát hiện và phòng thủ lại đòi hỏi nguồn lực lớn hơn nhiều.

Một hướng đi mới là xây dựng các tiêu chuẩn xác thực nguồn gốc nội dung, giúp người dùng biết được dữ liệu đến từ đâu và đã bị chỉnh sửa hay chưa. Song giải pháp này vẫn đối mặt nguy cơ bị làm giả nếu không có hệ thống kiểm chứng chặt chẽ.

Trong dài hạn, các công cụ phát hiện deepfake được dự báo sẽ trở thành lớp bảo vệ mặc định, tích hợp trực tiếp vào trình duyệt, nền tảng số hoặc hạ tầng Internet – tương tự vai trò của phần mềm diệt vi rút hiện nay.

AI có hơn người không?

AI có hơn người không?