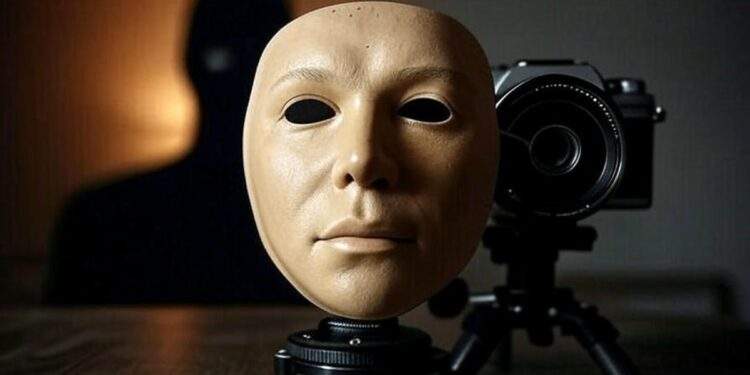

Công nghệ deepfake khiến ranh giới thật – giả trở nên mờ nhòe đến nguy hiểm

Deepfake là gì?

Bạn mở điện thoại và hoảng hốt thấy một video đang lan truyền: khuôn mặt và giọng nói của bạn đang phát biểu gây tranh cãi trong một sự kiện bạn chưa từng tham dự. Dù biết rõ đó không phải mình, video vẫn quá thật để nghi ngờ. Đây không phải phim viễn tưởng, mà là sản phẩm của deepfake, công nghệ AI có thể khiến bạn “làm” những điều chưa từng làm.

Trong thời đại mà thật – giả đang bị xóa nhòa, deepfake không chỉ là trò vui trên mạng. Nó có thể bị lợi dụng để mạo danh, bôi nhọ, lừa đảo, thậm chí đe dọa an toàn cá nhân. Vậy deepfake thực sự là gì? Và chúng ta – người dùng phổ thông – phải làm gì để nhận biết và tự bảo vệ mình?

Deepfake là công nghệ dựa trên học sâu (deep learning) – một nhánh của trí tuệ nhân tạo – để tạo ra những hình ảnh, video hoặc bản ghi âm giả mạo, nhưng trông chân thực đến mức khó phân biệt với hiện thực.

Về cơ bản, hệ thống sẽ “học” hàng trăm, thậm chí hàng nghìn bức ảnh và đoạn video gốc của một người, nắm bắt chi tiết từ dáng đi, nét mặt đến ngữ điệu giọng nói. Sau đó, AI sẽ ghép những chuyển động hoặc âm thanh này vào bất kỳ nội dung gốc nào, làm cho nhân vật trong video hoặc người nói trong đoạn thu âm dường như “phát ngôn” những lời mà họ chưa từng nói.

Thời gian gần đây, một loạt video lan truyền trên YouTube và mạng xã hội cho thấy Barron Trump tổ chức đám cưới với Công chúa Leonor của Tây Ban Nha trong một buổi lễ xa hoa. Tuy nhiên đây hoàn toàn là sản phẩm của trí tuệ nhân tạo, được tạo ra bởi kênh “Lovely Trump Family” với mục đích giải trí.

Mặc dù các video này có chú thích rằng chúng được tạo bằng AI, nhưng vẫn gây ra sự nhầm lẫn và tranh cãi trong dư luận.

Deepfake “học” khuôn mặt và giọng nói của bạn như thế nào?

Hãy tưởng tượng AI như một họa sĩ siêu nhanh và một ca sĩ “bắt chước tài tình”. Để vẽ khuôn mặt bạn, nó chỉ cần một bức ảnh hoặc vài giây video:

Học khuôn mặt: AI nhìn thật kỹ từng chi tiết trên ảnh: khoảng cách mắt, hình dáng mũi, miệng, nếp nhăn khi bạn cười. Sau đó nó “vẽ” lại khuôn mặt đó lên khung hình khác, giống như họa sĩ chép phác thảo rồi thêm màu và chi tiết. Kết quả là khuôn mặt bạn xuất hiện tự nhiên trên video gốc dù bạn chưa từng có mặt ở đó.

Học giọng nói: AI nghe bạn nói vài giây, ghi nhớ cao độ, nhịp điệu và tông giọng. Rồi nó “hát lại” cùng nội dung mới, giống như ca sĩ cover, nhưng giữ nguyên “chất” giọng của bạn.

Nhờ vậy, chỉ với 1-2 ảnh và 3-5 giây thu âm, deepfake đã có thể “bắt chước” bạn để tạo video hoặc audio giả mạo. Công nghệ này nhanh, tiện và… hơi “ma thuật”, nhưng cũng chính vì vậy, nó rất dễ bị lạm dụng để làm giả danh tính và phát tán thông tin sai lệch.

Deepfake nguy hiểm như thế nào?

Deepfake không chỉ đơn thuần gây cười hay thỏa mãn tính tò mò, nó còn tiềm ẩn nhiều mối nguy cho cá nhân và xã hội:

Mạo danh, lừa đảo tài chính: Kẻ gian có thể dùng giọng nói deepfake để giả làm sếp, người thân gọi điện nhờ chuyển tiền gấp. Chỉ cần vài giây thu âm giọng thật của bạn, điện thoại giống hệt “ông chủ” hoặc “bố mẹ” thúc giục, nạn nhân rất dễ mất cảnh giác.

Một ví dụ điển hình: năm 2019, một giám đốc tại Anh đã bị lừa chuyển 220.000 euro sau khi nhận được cuộc gọi deepfake mạo danh giám đốc điều hành công ty mẹ.

Xâm phạm danh dự, bôi nhọ cá nhân: Video ghép mặt vào cảnh nhạy cảm (phim “mát mẻ”, cảnh bạo lực…) có thể lan truyền, khiến người trong video chịu tổn thương nặng nề về tinh thần và uy tín. Một khi đã xuất hiện trực tuyến, những video này rất khó gỡ bỏ hoàn toàn, dù đã chứng minh là giả mạo.

Phát tán tin giả, thao túng dư luận: Trong bối cảnh chính trị nhạy cảm, video deepfake nhà lãnh đạo phát ngôn điều chưa bao giờ nói có thể gây hoang mang, mất niềm tin vào truyền thông và chính phủ.

Đe dọa an ninh cá nhân và quốc gia: Với công nghệ đủ tinh vi, kẻ xấu có thể phát tán video deepfake về tình trạng khẩn cấp giả (như chiến tranh, thảm họa), kích động hoảng loạn, hỗn loạn xã hội. Cơ quan an ninh cũng phải đối mặt với thách thức lớn trong việc phân biệt thật – giả trước các thông tin tình báo nguy hiểm.

Dù deepfake mở ra nhiều cơ hội giải trí và sáng tạo, nó đồng thời cũng trở thành “vũ khí” tinh vi, đòi hỏi cả cá nhân và cơ quan chức năng phải nâng cao cảnh giác. Trong phần sau, chúng ta sẽ cùng tìm hiểu cách tự bảo vệ mình khỏi hiểm họa này.

Làm sao để bảo vệ bản thân khỏi deepfake?

Dù không thể tránh hoàn toàn nguy cơ bị deepfake “nhắm đến”, bạn vẫn có thể giảm thiểu rủi ro bằng một số cách đơn giản nhưng hiệu quả:

Hạn chế chia sẻ hình ảnh, video cá nhân công khai: Càng nhiều dữ liệu khuôn mặt, giọng nói bạn đưa lên mạng xã hội, AI càng có nguyên liệu để tạo deepfake. Hãy để chế độ riêng tư, và suy nghĩ kỹ trước khi đăng.

Cẩn trọng với cuộc gọi, video khả nghi: Nếu nhận được cuộc gọi hay video từ người quen nhưng có nội dung bất thường (như yêu cầu chuyển tiền, phát ngôn lạ lẫm…), đừng vội tin. Hãy xác minh lại bằng cách gọi trực tiếp hoặc nhắn tin theo kênh khác.

Sử dụng công cụ phát hiện deepfake: Một số nền tảng và công ty bảo mật đã phát triển công cụ kiểm tra hình ảnh/video xem có dấu hiệu bị can thiệp bởi AI hay không. Tuy chưa hoàn hảo, nhưng chúng là bước đầu hữu ích để nhận biết.

Giữ “dấu vết số” an toàn: Không chia sẻ các bản ghi âm giọng nói, video rõ mặt ở môi trường không kiểm soát (như chatbot lạ, app chưa rõ nguồn gốc). Một đoạn ghi âm ngắn cũng có thể bị trích xuất để giả mạo bạn.

Trang bị kiến thức – cảnh giác đúng mức: Không hoang mang, nhưng cần hiểu rõ: deepfake đã vượt xa công nghệ giải trí. Hãy chia sẻ kiến thức này đến người thân, đặc biệt là người lớn tuổi và trẻ em – nhóm dễ bị lừa bởi nội dung trông “giống thật”.

Bạn không thể ngăn AI tiến bộ, nhưng hoàn toàn có thể bảo vệ mình bằng nhận thức, cảnh giác và sự chủ động. Trong một thế giới mà thật – giả chỉ cách nhau vài cú click, hiểu biết chính là tấm khiên tốt nhất.