Điểm mới của dự thảo là phương thức quản lý theo mức độ rủi ro, phân hệ thống AI thành nhiều cấp độ khác nhau nhằm đảm bảo sự linh hoạt và khuyến khích phát triển trong nước và hướng đến tự chủ công nghệ…

Tại phiên họp sáng 21/11 của Kỳ họp Quốc hội thứ 10, Bộ trưởng Bộ Khoa học và Công nghệ Nguyễn Mạnh Hùng trình bày báo cáo về dự án Luật Trí tuệ nhân tạo (AI), đạo luật được kỳ vọng trở thành bước đột phá trong kiến tạo hành lang pháp lý cho công nghệ mang tính nền tảng của thời đại.

Theo Bộ trưởng, mục tiêu của Luật không chỉ là thúc đẩy đổi mới sáng tạo và nâng cao năng lực cạnh tranh quốc gia, mà còn nhằm quản lý rủi ro, bảo vệ quyền con người, an ninh – chủ quyền số, đồng thời thể chế hóa các chủ trương quan trọng của Đảng và Nhà nước về phát triển AI.

Một trong những tinh thần cốt lõi của dự thảo Luật là đặt con người ở vị trí trung tâm, với nguyên tắc: AI phục vụ con người, không thay thế con người, và con người giữ quyền giám sát trong những quyết định quan trọng. AI phải đảm bảo tính minh bạch, trách nhiệm, an toàn trong toàn bộ vòng đời vận hành.

Điểm mới của dự thảo là phương thức quản lý theo mức độ rủi ro, phân hệ thống AI thành nhiều cấp độ khác nhau nhằm đảm bảo sự linh hoạt và khuyến khích phát triển và hướng đến tự chủ công nghệ AI.

Dự thảo lần này đồng thời kế thừa và bãi bỏ những quy định liên quan tại Luật Công nghiệp công nghệ số 71/2025/QH15, bổ sung những “khoảng trống” còn thiếu để xây dựng một hệ thống pháp lý đồng bộ cho AI.

Dự thảo Luật áp dụng cho cả cá nhân, tổ chức trong và ngoài nước có hoạt động phát triển, cung cấp, triển khai hoặc sử dụng hệ thống AI tại Việt Nam, hoặc tạo ra sản phẩm AI được sử dụng trong lãnh thổ Việt Nam.

Điều này sẽ phù hợp với bản chất xuyên biên giới của công nghệ AI và các mô hình nền tảng quốc tế.

Thay mặt cơ quan thẩm tra, Chủ nhiệm Ủy ban Khoa học, Công nghệ và Môi trường Nguyễn Thanh Hải cho rằng việc xây dựng Luật dưới dạng Luật khung là hợp lý.

Tuy nhiên, tốc độ phát triển quá nhanh của AI khiến nguy cơ Luật cần phải sửa đổi trong thời gian ngắn là điều “có thể xảy ra”.

Một số ý kiến đề nghị coi Luật AI là “Luật gốc”, từ đó mỗi luật chuyên ngành phải bổ sung một chương riêng về AI để đồng bộ hóa hệ thống pháp luật.

Ủy ban cơ bản đồng ý với phân loại rủi ro thành bốn mức: thấp, trung bình, cao và không chấp nhận được. Tuy nhiên, dự thảo hiện chưa đưa ra tiêu chí định lượng hoặc định tính rõ ràng, thiếu quy định về biện pháp quản lý, công cụ đánh giá, dẫn tới sự lúng túng cho doanh nghiệp trong việc tự phân loại rủi ro và lo ngại trách nhiệm pháp lý.

Ủy ban đề nghị rà soát, cắt giảm các thủ tục tiền kiểm như yêu cầu hồ sơ kỹ thuật hay nhật ký hoạt động trước khi lưu hành sản phẩm. Nếu quy định quá chặt, chi phí tuân thủ sẽ tăng, đổi mới sáng tạo bị chậm lại và khả năng thu hút đầu tư suy giảm. Quan điểm của Ủy ban là cần chuyển mạnh sang cơ chế hậu kiểm, phù hợp với bản chất thay đổi nhanh của AI.

Đối với đề xuất thành lập Ủy ban Quốc gia về AI, Ủy ban thẩm tra yêu cầu làm rõ thẩm quyền thành lập, cơ chế hoạt động và tổ chức bộ máy. Mô hình này phải gắn chặt với Sáng kiến số 26 – “Hình thành trung tâm đầu não về nghiên cứu, đào tạo và thử nghiệm AI”.

Dữ liệu là nền tảng của AI, nhưng dự thảo Luật hiện chưa quy định đầy đủ nguyên tắc về chất lượng dữ liệu. Ủy ban đề nghị bổ sung bộ tiêu chí “đúng – đủ – sạch – sống”, đồng thời yêu cầu dữ liệu phải được liên thông, không phân tán để tránh tạo điểm nghẽn cho nghiên cứu và triển khai AI.

Bên cạnh đó, phải có quy định bắt buộc về bảo mật, an ninh mạng, phòng vệ hệ thống AI quốc gia để ngăn ngừa rò rỉ dữ liệu hoặc chiếm quyền điều khiển.

Chủ nhiệm Ủy ban Khoa học, Công nghệ và Môi trường Nguyễn Thanh Hải đề nghị bổ sung một mục riêng về việc sử dụng AI trong đào tạo, nghiên cứu và đổi mới sáng tạo – lĩnh vực đang tạo ra những đột phá lớn như “thiết kế protein”, khám phá vật liệu mới, hay mô phỏng khoa học. Ủy ban đề nghị bổ sung một mục riêng về nội dung này, bao gồm: quyền tác giả, bảo mật dữ liệu nghiên cứu, chia sẻ dữ liệu, cơ chế sandbox và miễn trừ trách nhiệm khi đã tuân thủ quy định.

Ủy ban cũng đề nghị mở rộng các hành vi bị cấm, nhằm nhận diện và ngăn chặn nguy cơ từ giai đoạn nghiên cứu đến triển khai.

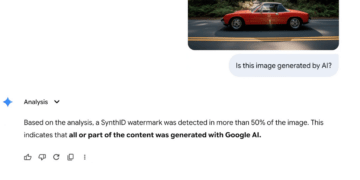

Các hành vi cần được cấm bao gồm: lợi dụng AI để kích động chính trị, gây rối an ninh, thao túng bỏ phiếu – bầu cử; sử dụng AI để tạo nội dung giả mạo, hình ảnh – video nhằm lừa đảo, xúc phạm danh dự, chia rẽ cộng đồng hoặc phục vụ các mục đích xấu khác,…

-Hạ Chi